新書推薦:

《

教育研究量表手册 21世纪教育科学系列教材

》

售價:NT$

454

《

真事隐:康熙废储与正史虚构

》

售價:NT$

398

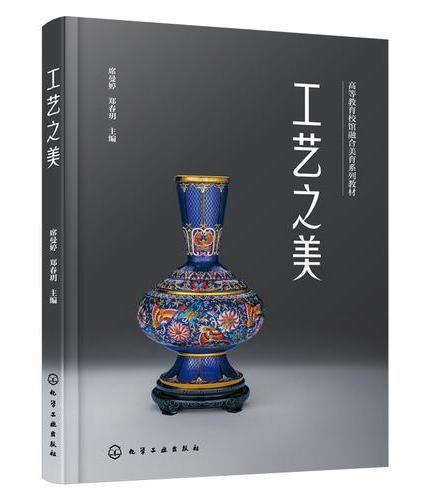

《

工艺之美(席曼婷)

》

售價:NT$

454

《

揭秘煤气灯效应:心理操控的哲学透视

》

售價:NT$

281

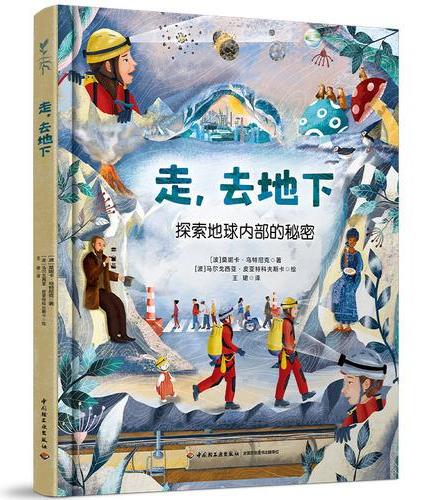

《

走,去地下 探索地球内部的秘密【精装大本】

》

售價:NT$

449

![含混的哲思——梅洛-庞蒂·杨大春讲梅洛-庞蒂[修订本合集]](//img.megbook.hk/upload/mall/productImages/26/7/9787303310944.jpg)

《

含混的哲思——梅洛-庞蒂·杨大春讲梅洛-庞蒂[修订本合集]

》

售價:NT$

857

《

财务炼金术:AI时代从财务小白到超级个体的成长手册

》

售價:NT$

454

《

粤港澳大湾区的创新创业故事

》

售價:NT$

449

|

| 編輯推薦: |

|

《大数据金融分析实训教程》以金融数据分析师、金融数据产品经理岗位内容为基础,以金融数据应用为导向,贯穿金融数据采集、数据清洗、数据存储及数据分析与展示等方面构建课程体系,将实际岗位需求融入典型工作任务中,通过模拟金融科技领域真实的业务场景进行数据分析实训,配套建设了在线教学和实训资源,深入浅出地阐述了大数据在金融领域各个环节的关键作用与实践要点。本教程适用于金融类专业的高校学生、金融行业从业者以及对大数据金融分析感兴趣的自学者。

|

| 內容簡介: |

|

《金融大数据分析实训》是专为职业本科教育金融大数据分析课程设计的专业技能核心教材,总学时为64学时,同时该教材也能用于大数据金融实训课程。该教材融入了1+X金融大数据处理证书的最新技能要求,教材开发遵循职业教育人才培养与职业本科教育教学规律,在对课程所对应的金融数据分析师、金融数据产品经理岗位能力精准分析的基础上进行开发。内容涵盖如下主要项目,依次为:金融大数据基础认知、Python与金融数据处理入门、金融数据的采集与预处理、金融数据库的设计与应用、金融大数据统计与可视化、时间序列分析与预测模型、机器学习与金融数据应用、量化投资与回测、等等。所有的项目案例都取自深圳希施玛数据科技有限公司的真实项目,并且对应金融大数据分析的五大岗位流程,即数据采集、数据处理、数据存储、数据分析与挖掘、数据可视化与报告呈现。

|

| 關於作者: |

|

黄侃梅,高校教师,副教授,高级理财规划师,高级金融科技师。长期从事证券实务专业、金融科技应用专业专业建设与研究,具有丰富的金融证券期货实战经历。主持或参与省市级课题项目10多项,在国内外知名期刊发表包括核心期刊的学术论文30余篇。拥有专利著作权2项,主编或参编各类教材7本,其中1本教材《投资与理财》荣获全国及上海市十四五规划教材奖。多次主持《证券投资理论与实务》、《期货交易实务》、《投资与理财》、《高等数学》、《统计学》的课程建设与研究,并荣获上海市精品在线课程荣誉2次,上海市教学资源库荣誉1次,教育部拓金课程荣誉1次等多项教研荣誉。

|

| 目錄:

|

目 录

项目一 金融大数据基础认知

任务一 认识金融数据与大数据

任务实施

金融大数据认知训练

任务二 认知金融大数据思维

任务实施

大数据思维训练

任务三 了解数据相关法律法规

任务实施

数据法律法规认知训练

项目二 Python与金融数据处理入门

任务一 初识Python

任务实施

Python环境的下载与安装

任务二 认识Python数据分析的常用模块

任务实施

一、Python模块的安装和导入

二、人民币和美元的兑换

项目三 金融数据的采集与处理

任务一 金融数据Excel采集技术

任务实施

一、宏观数据采集

二、行业数据采集

三、上市公司数据采集

任务二 金融数据Python采集技术

任务实施

一、了解Python自动化采集

二、利用Python进行接口数据采集

任务三 金融数据Excel处理

任务实施

一、数据预处理

二、数据质检与清洗

任务四 金融数据Python处理

任务实施

Python数据预处理

项目四 金融数据库的设计与应用

任务一 金融数据存储技术

任务实施

一、使用SQL语言创建股票信息表

二、使用SQL计算MACD指标

三、SQL语句处理数据缺失问题

任务二 金融数据库设计与规范

任务实施

一、分析业务需求

二、构建ER图

三、优化设计

任务三 金融数据查询与分析

任务实施

一、SQL数据查询

二、Python数据查询

项目五 金融大数据统计与可视化

任务一 描述性统计

任务实施

一、上证50指数收益率数据描述性统计分析

任务二 数据可视化操作

二、Python作图分析

项目六 时间序列分析与预测模型

任务一 时间序列分析基础

任务实施

一、描述性统计与离散程度分析

二、自相关性、季节性、趋势与波动性分析

任务二 时间序列变动趋势分析与预测

任务实施

一、序列差分分析

二、季节性波动和白噪声分析

任务三 掌握时间序列预测模型(如ARIMA, GARCH)

任务实施

时间序列分析

项目七 机器学习与金融数据应用

任务一 机器学习基础与算法介绍

任务实施

用Python和scikit-learn库实现机器学习模型

任务二 信用评分模型与操作

任务实施

基于逻辑回归建立个人贷款信用评分模型

任务三 欺诈检测模型与操作

任务实施

构建信用卡欺诈检测模型

任务四 股票价格预测模型与操作

任务实施

利用线性回归模型预测未来股票价格

项目八 金融大数据在量化投资中的应用

任务一 熟悉量化投资策略

任务实施

海龟交易策略

任务二 Python在量化策略开发中的应用

任务实施

同花顺(300033SZ)量化投资分析

任务三 策略回测与性能评估

任务实施

股票回测与性能评估

项目九 金融大数据在商业银行中的应用

任务一 客户关系管理与数据分析

任务实施

构建RFM模型分析和评估客户价值

任务二 信贷风险评估与模型构建

任务实施

测算对私客户违约风险

任务三 信贷策略的优化与实践

任务实施

小微企业信贷风险评估

项目十 金融大数据在保险行业的应用

任务一 保险业定价策略与数据分析

任务实施

基于Python sklearn库构建差异化定价模型

任务二 保险业精准营销与数据分析

任务实施

机器学习算法驱动保险精准营销模型实操

参考文献

|

| 內容試閱:

|

前言

在当今数字化时代,金融行业正经历着前所未有的深刻变革。大数据技术的蓬勃兴起,犹如一股强大的洪流,冲击并重塑着传统金融业务的模式与格局。它不仅为金融机构提供了海量的数据资源,更开启了一扇通往精准决策、高效风险管理以及创新金融产品与服务的大门。在此背景下,掌握大数据金融分析技能已成为金融领域专业人士和相关从业者不可或缺的核心竞争力。

本实训教程旨在为广大读者搭建一座从理论知识通往实际操作的坚实桥梁,帮助大家系统地学习和掌握大数据金融分析的方法与技术。本教程以金融数据分析师、金融数据产品经理岗位内容为基础,以金融数据应用为导向,贯穿金融数据采集、数据清洗、数据存储及数据分析与展示等方面构建课程体系,将实际岗位需求融入典型工作任务中,通过模拟金融科技领域真实的业务场景进行数据分析实训,深入浅出地阐述了大数据在金融领域各个环节的关键作用与实践要点。

本教程适应金融科技的发展趋势,按照新型活页式教材的要求而编写,具有如下特色:

1.以数字化技能考证标准为依据,岗课结合

考证导向明确,精准对标1+X金融大数据处理职业资格认证及商务数据分析师考试大纲,详细解析考点并融入实训内容,配备全真模拟考证题库与智能评分系统,助力学生顺利获取职业资格证书。

2.以实际工作任务为起点,理实结合

本书以实际工作任务为起点,理实结合,将复杂金融场景拆解为具象化案例,并基于真实业务数据开展实战演练,帮助学生精准掌握金融分析核心技能,无缝对接职场需求。比如:以金融数据采集任务开启知识铺垫,通过信贷风险评估任务深化理论应用,依托投资策略分析任务巩固实操技能,构建系统学习链路。

3.以“项目、任务”式构建教材结构,形式多样

本书以典型工作任务等为载体进行设计,按照“项目、任务”为主线进行教材结构与体例设计,每一个项目都分解为若干个子任务。每一个任务都以任务导入、任务布置、任务解析、知识锦囊、素质拓展、任务实施、实战演练展开讲述,其中“任务实施”讲述具体的任务过程,每一个项目结束之时进行项目总结,每一个项目配备了适当的项目测试及测试答案,每篇项目及任务之后都附有若干微课视频,以扩充学生的知识面。

4.以丰富教辅资源配套实训教程,提高学习效果

本书配套建设了在线教学和实训资源,包括课件、微课、习题、金融数据案例视频、行业专家讲解等资源,通过专属草料二维码平台,让学生随时随地扫码获取学习资料,且可在平台上互动交流、分享见解,形成活跃的学习社区。

为了确保教程的实用性和先进性,我们整合了行业内主流的大数据分析工具与平台,如 Python 语言及其相关的数据处理和分析库(Pandas、NumPy、scikit-learn 等),并详细介绍了它们在金融数据分析中的具体应用。读者通过学习这些内容,能够熟练掌握在实际工作中所需的工具技能,快速上手处理和分析金融大数据。

本教程适用于金融类专业的高校学生、金融行业从业者以及对大数据金融分析感兴趣的自学者。无论是希望在金融领域深入发展的专业人士,还是渴望跨学科学习新兴技术的初学者,都能从本教程中获得有价值的知识与实践指导。我们相信,通过对本教程的学习与实践,读者将能够更好地适应金融行业数字化转型的浪潮,在大数据金融这片广阔的领域中开拓创新,实现个人职业发展与专业成长的新突破。

最后,在教程的编写过程中,我们得到了众多金融领域专家、学者以及数据分析师的悉心指导与大力支持,在此表示衷心的感谢。尤其感谢深圳希施玛数据科技有限公司的张凌霜女士,本书的任务实施操作的大部分案例来源于该公司的真实实践场景。同时,本书的顺利出版,离不开全体编委会成员及学校教务处、学院领导给予的宝贵指导意见。本书由黄侃梅老师负责组织及全书统稿,由郭淑娟、徐俪宁、谭会荣三位老师参与编写,再次感谢各位参与编写的老师。

由于大数据金融分析领域仍在不断发展与演进,教程中难免存在不足之处,欢迎广大读者批评指正,以便我们在后续的修订中不断完善。

让我们一同开启大数据金融分析的学习之旅,探索金融数据背后的无限奥秘与价值!

本书是上海市民办高校2024“民师计划”项目“人工智能赋能‘大数据金融分析’课程实践教学研究”的研究成果之一。

二、数据格式规范

(一)数据格式查看

首先查看表3-4-1中各列的数据类型,如不符合预期则进行类型转换。代码如下:

print(frame.dtypes)

运行结果如下:

指标 object

地区 object

2016年 object

2017年 object

2018年 object

2019年 object

2020年 object

dtype: object

2016年至2020年CPI数据均为object字符类型,需要将其转换成数值浮点型。

(二)数据格式转换

将2016年的数据转化为数值浮点型数据,程序如下,发现运行报错。

frame = frame.astype({‘2016年’:‘float64’})

ValueError: could not convert string to float: ’103%’

检查运行错误原因,显示不能把字符串103%转换成float类型。观察表1.3.1,发现“河北省”的CPI数值后有‘%’,需要先去除‘%’,然后再转换成float类型。代码如下:

#字符串的末尾($)是%的,替换为空字符

frame=frame.replace(r’%$’,’’,regex=True)

#将2016到2020年的列数据用字典方式转换为数值浮点型

frame = frame.astype({’2016年’:’float64’,’2017年’:’float64’,’2018年’:’float64’,’2019年’:’float64’,’2020年’:’float64’})

#查看转换后的数据类型是否是浮点型

print(frame.loc[:,[”2016年”, ”2017年”,”2018年”,”2019年”,”2020年”]].dtypes)

运行结果如下。

2016年 float64

2017年 float64

2018年 float64

2019年 float64

2020年 float64

dtype: object

(三)空字符及特殊字符处理

从表3-4-1的读取结果可以看到,“地区”列有一些空字符及特殊字符存在,这些符号不利于后续的数据存储及分析,需要进行清除。代码如下:

#将1至多个任意空白字符替换成空字符

frame = frame.replace(r’\\s+’,’’,regex=True)

#将“地区”列数据中的特殊字符*和-去掉

frame[’地区’]=frame[’地区’].replace(r’\\*’,’’,regex=True).replace(r’-’,’’,regex=True)

此外,从表3-4-1中可以发现各年的CPI数据小数位数并不统一,小数点后保留有1位,有的保留3位,有的是整数,应该要进行小数位数统一处理。但是后续在进行数据异常值检测、空值填充时可能要进行数据计算,并将计算结果填充或替换进frame数据中。通常计算出的数值是多位小数,这些多位小数被填充进frame中后,Python会自动将该位置所在列的全部数据变成统一小数位置,导致需要再次统一小数位数。因此暂时不进行小数位数统一,待全部计算完毕后再处理。

三、异常值处理

观察表3-4-1中数据,发现有个别CPI数据为空,在进行缺失值填充之前,先进行异常值检测,以免使用均值或邻近值填充缺失值的时候受到异常值的影响。

通过查看各数据列的简单统计描述信息,找出明显异常的数据,代码如下。

print(frame.describe()) #查看数值类型列的统计描述信息

运行结果如下:

2016年 2017年 2018年 2019年 2020年

count 32.000000 32.000000 31.000000 32.000000 31.000000

mean 104.131250 98.728750 101.749548 136.453750 107.826129

std 1.079626 1.099621 0.903570 167.074647 1.649638

min 101.560000 96.840000 100.224000 103.300000 104.800000

25% 103.275000 97.975000 101.066000 106.050000 106.715000

50% 104.300000 98.725000 101.739000 107.100000 107.900000

75% 104.747500 99.340000 102.350500 107.955000 108.950000

max 106.100000 101.100000 103.378000 1052.000000 111.600000

从统计结果可以发现,2019年列的最大值为1052,该数值明显和其他数值出入较大。经过原数据的比对,发现为数据录入时出现错误,将105.2误输入成1052,对表格数据进行更正。

print(frame[’2019年’].values) #输出替换前该列数据的值

frame[’2019年’].replace (1052,105.2, inplace=True) #inplace=True更正后结果覆盖原数据

print(frame[’2019年’].values) #输出替换后该列数据的值

运行结果:

[ 106.1 106.3 105.4 1052 104.6 …………]

[106.1 106.3 105.4 105.2 104.6 105.9 ………]

四、重复值删除

分析表3-4-1中数据,近五年CPI的值是允许出现重复的,无需进行判断和处理。只有“地区”列,不应该出现重复,因此只需分析该列是否存在重复数据。

(一)重复值检测

重复值的判断有多种方法,第一种是用duplicated()方法对每一行是否重复进行判断;第二种方法是利用describe()方法输出中的唯一值来进行重复值判断。

第一种方法,使用duplicated()函数,代码如下。

print(frame.duplicated(’地区’))

运行结果如下,发现22行出现重复值。

…………

18 False

19 False

20 False

21 False

22 True

23 False

第二种方法,使用describe()函数,代码如下。

print(frame.describe(include=’object’))

运行结果如下,发现“地区”列的“重庆市”重复了2次。

指标 地区

count 29 31

unique 1 30

top 食品 重庆市

freq 29 2

结合两种方法的结果,可以得知22行、“地区”列重复了,重复值为“重庆市”。

(二)重复值删除

对比重复的两行数据,发现数据完全一致,因此需要将重复记录进行删除,代码如下:

frame = frame.drop_duplicates(’地区’,keep=’last’) #将地区名出现重复的记录删除,保留最后出现的数据

五、缺失值处理

(一)空值检测

从结果中明显发现一个空行,需要删除。除空行外,可以发现数据中还存在不少空值,用isnull()函数检测空值情况。代码如下:

print(frame.isnull().all(axis=1)) #查看是否有全为空的行,axis=1表示按行查看

frame=frame.dropna(how=‘all’) #删除全部为空的行

print(frame.isnull().any()) #查看是否有存在任意一个空值的列

运行结果如下:

指标 True

地区 True

2016年 False

2017年 False

2018年 True

2019年 False

2020年 True

dtype: bool

从运行结果可以看出,“指标”、“地区”、“2018年”、“2020年”4列都存在缺失值,但是无法得知空值的个数,需要再次去查询各列数据。当数据量较大时,通过人工观测缺失数据容易出现偏差,因此用info()函数查看每列数据的类型及非空值个数,对缺失值数量和位置进一步了解。代码如下:

print(frame.info()) #查看数据

从运行结果如下所示。可以看出一共有32行,“指标”列有29个非空值,也就是说有3个空值;“地区”、“2018年”、“2020年”三列均有31个非空值,1个空值。

Int64Index: 32 entries, 0 to 32

Data columns (total 7 columns):

# Column Non-Null Count Dtype

--- ------ -------------- -----

0 指标 28 non-null object

1 地区 30 non-null object

2 2016年 31 non-null float64

3 2017年 31 non-null float64

4 2018年 30 non-null float64

5 2019年 31 non-null float64

6 2020年 30 non-null float64

dtypes: float64(5), object(2) memory usage: 1.9+ KB None

|

|

![含混的哲思——梅洛-庞蒂·杨大春讲梅洛-庞蒂[修订本合集]](http://img.megbook.hk/upload/mall/productImages/26/7/9787303310944.jpg)